Google, onderdeel van Alphabet, heeft klokkenluider en senior software engineer Blake Lemoine uiteindelijk definitief ontslagen. Lemoine beweert dat de kunstmatige intelligentie (AI) chatbot LaMDA van het bedrijf naar een zelfbewust persoon neigt. Hij gebruikt het woord ‘sentient’. LaMDA staat voor Language Model for Dialogue Applications.

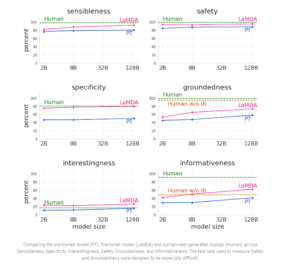

De bewering van Lemoine is waar. Hij is dus niet ontslagen omdat hij liegt, maar net omdat hij de waarheid vertelt. Wie trouwens de paper LaMDA: Towards Safe, Grounded, and High-Quality Dialog Models for Everything leest, ziet dat de chatbot op diverse ‘menselijke’ aspecten naar de menselijke volwaardigheid neigt. (zie onder) Niet op alle onderdelen, maar zeg nu zelf: de vriend die compleet lazarus op café zit, is waarschijnlijk minder zelfbewust dan LaMDA. Nogmaal: Google heeft Lemoine dus ontslagen omdat hij de waarheid vertelt. En bovendien heeft de mens een veel te hoge dunk van zichzelf: LaMDA weet meer over de Mount Everest dan de gemiddelde kroegtijger.

De gespreksvaardigheden van LaMDA zijn overigens al jaren in de maak. Zoals veel recente taalmodellen, waaronder BERT en GPT-3, is het gebaseerd op Transformer, een neurale netwerkarchitectuur die Google Research in 2017 heeft uitgevonden en open source heeft gemaakt. Die architectuur levert een model op dat getraind kan worden om veel woorden te lezen (bijvoorbeeld een zin of alinea), aandacht te besteden aan hoe die woorden zich tot elkaar verhouden en vervolgens te voorspellen welke woorden het denkt dat er daarna zullen komen. Een beetje zoals de mens die dat ook allemaal moet leren. Het fundamentele verschil?

Misschien is het wel fout om de mens vs machine als tegenstelling of dichotomie te beschouwen. Josiah Ober, hoogleraar aan Stanford University op het blog stayhappening.com. "Ik wil een derde perspectief toevoegen."

Slavernij in het oude Griekenland was een 'prototype' van AI, schrijft Ober. Alomtegenwoordig, onmisbaar, en gezien als iets wat nog net geen mens is - volgens Aristoteles was een slaaf 'ademend bezit'. Ober: "Dat denken leverde ingewikkelde ethische vragen op. Waarin verschillen slaven van ons? Hebben ze rechten? Wat is 'mishandeling'? Kun je er bevriend mee raken? Wat gebeurt er als je ze vrijlaat?"

Trouw: “Het zijn zo'n beetje dezelfde vragen als die Googles chatbot LaMDA oproept.” De antwoorden uit de Oudheid neemt Ober niet zomaar over. "Maar de lange worsteling van de Grieken ermee levert wel een extra repertoire om na te denken over een intelligente machine."

Volgens Ilyaz Nasrullah is de chatbot van Google toch niét intelligent: “LaMDA is een voorbeeld van wat een large language model genoemd wordt. Deze programma's worden gemaakt door ze te voeden met werkelijk gigantische hoeveelheden tekst. Op basis van die teksten wordt een voorspellingsmodel opgebouwd. Dit model voorspelt welke woorden waarschijnlijk horen te volgen op de woorden die eerder gebruikt werden in het 'gesprek'.” Een beetje zoals een mens dus, want een echt fundamenteel onderscheid is er nog steeds niet.

Ray Kurzweil meent dat informatieverwerkende machines over pakweg twintig jaar zo slim zullen worden dat zij hun makers (de mens) voorbij zullen streven. Als dat al niet sneller gebeurt. Anderen betogen dat deze eindeloze discussie nergens toe leidt. 'We hebben geen intelligente machines en we hebben geen bewuste machines', zei bijvoorbeeld filosoof Luciano Floridi in 2017 in de Volkskrant. Een zaak is wel zeker: Blake Lemoine heeft een erg gevoelige snaar geraakt en enkel daarvoor moeten we hem zeer dankbaar zijn.